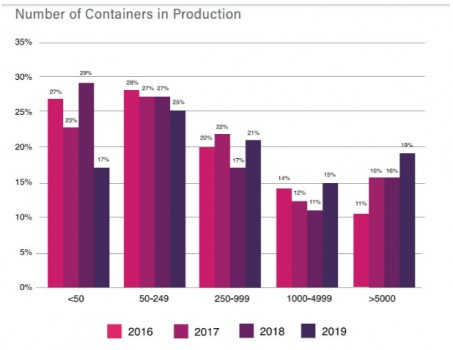

����CNCF����2019����ȵ��鱨����ʾ,������ʵ�����������е�ʹ������������,2016���2018�������ʹ���ʷֱ���23%��73%,����2019��,��һ������������84%������ʹ����,�����IJ����ģҲ������,�ڵ�����,58%���ܷ��߱�ʾ����������������250�����ϡ�

�����������ﵽһ����ģʱ,����Ҫ��������ƽ̨�ˡ��ʼ,ҵ���ܹ��Ƶ�����������ƽ̨�ľ�ֻ��Kubernetes,Swarm ֻ������һ������ƽ̨,ͬʱ����ҪCompose �� Docker Machine�ȹ��ߵ����,Mesos��Ȼ��Ϊ��Դ����ƽ̨�ܹ���������,������Ҫ���Ź��ߺ�����������ϡ�

����,Kubernetes “��������”�ľ���û�г����ܾ�,����������ƽ̨����ͳ�����һ��������——DC/OS��DC/OS �� D2iQ��˾(ԭ��:Mesosphere)ǣͷ��Դ��һ����Ŀ,������ǻ��� Mesos ʵ�ֵ�,���Լ��л�����ʩ��Դ,��ʵ�ֿ����ֲ�ʽӦ����������Դ��

ѡ��ָ��:DC/OS ���� Kubernetes ?

“�������̴�������”,����ҵʵ������������,Kubernetes��DC/OSӦ�����ѡ����?һ����˵,����ѡ��Ҫ�ֶ������,�������ǾʹӼ�Ⱥ��ģ���������غ��Ӷ���������������ѡ�ͽ����

��ȺѡDC/OS,С��ȺѡKubernetes

���ǰѼ�Ⱥ��ģ���Է�Ϊ����������̸��,�ֱ��Ǽ�Ⱥ�����͵�����Ⱥ��ģ��

��Ⱥ����

����ļ�Ⱥ����ָ���Ǽ�Ⱥ���������ʵ���������,�������������ԡ������Լ�����ҵ��һ����������500����ȺΪ����,�������500.�Ϳ�����Ϊ�Ǵ�Ⱥ,Ӧ��ѡ��DC/OS,�������500.��ô����Ϊ����С��Ⱥ,���ʺ�ѡ��Kubernetes��

������Ⱥ��ģ

����˼��,������Ⱥ��ģָ�����ڵ�����Ⱥ�еĽڵ�������һ����˵,�������Ⱥ�ڵ�Ϊ8-10��,����ʹ��Kubernetes,������Ⱥ�ڵ㳬��100.����ʹ��DC/OS��

�ඨ��ʹ��DC/OS,�ٶ���ʹ��Kubernetes

����ӹ������صĽǶ�����,DC/OS��KubernetesӦ����ôѡ��?ҵ��Ƚ��ձ��ѡ�ͷ�����,�����ǧ�ڵ㼯Ⱥ�Ҷ��ƽ���ʹ��Kubernetes,���������ڵ㼯Ⱥ�Ҷ��ƽ϶�,���ʺ�ʹ��DC/OS��

DC/OS���ں���Mesos,Mesos����������˫����Ȼ���,��һ������Ƚ�����Node�����Framework,֮���ٽ��ж��ε��ȡ�����ж��Framework,�����Խ��в��е��ȡ�

Kubernetes���ݽṹ����Ʋ�αȽ�ϸ,��������������˼�롣���������->Pods->Deployment,ÿ�����е����������ܱ���װΪ��ô��IJ��,��ÿһ�㶼���Բ�����,���߱��Լ������á�

�����ڶ��Ʒ�������ó���,������һ�����������,�������dz����Ĵ��ľ,Mesos����ɢ�Ļ�ľ,��Ҫ�Լ���װ��ʵ��ҵ��ģ��,��Kubernetes������װ�õĻ�ľ,ֱ�������þͺ��ˡ�

����֮��,Ӧ��״̬Ҳ��һ����Ҫ���ǵ����ء�ͨ��,Ӧ�õ�״̬��Ϊ��״̬����״̬������,���ߵĹؼ���������״̬��Ϣ������������Ӧ������,����������������״̬,��֮��Ȼ��

��״̬Ӧ�����������Ӧ����˭,Ҳ����ͬ��������Ӧ��֮�����Ϣ,������ɾ��Ҳ����Ӱ������������״̬Ӧ����Ҫ��ʱͬ������,���ܶ�ʧ����,�����ڴ���Դ�������ݵ�,��˸���Ҫ�����Դ��������Kubernetes,DC/OS�����˺ܶ����,���Ƿֲ�ʽ����,����ܹ�֧�ָ������״̬����,��ʹ�Ǹ��ӵķֲ�ʽϵͳҲ�����ڼ������ڲ�����ɡ�

���Ӷ�:���⻧/�ಿ��Э��ѡDC/OS,��֮ѡKubernetes

���չ���,�����ȸ���ѡ�ͽ���:�����ҵ�ڲ��ж��ҵ����,������������ԡ�����ϵͳ,��ҪЭ�������ع���,���ӶȽϸ�,��ô����ѡ��DC/OS,��֮,����ѡ��Kubernetes����ô��������,����ҵ����ʵ����,���Ӷȶ�������ʲô�ط���?

�洢��Դ�ĸ��Ӷ�,����ҵ�ڵ��������Ļ��������һ��ʱ,��ô����Ҫ������ν�����ά���Ѷ�,��ΰ����ҵ��ϵͳ�ṩ��ʱ֧��;

������ĸ��Ӷ�,����ҵ���ڶಿ�š���ҵ��,������ͬ��ʱ��,��ô��Ҫ�����������ƽ̨�ṩ������Դ�ṩ���Ķ��ƻ�����;

�������̺���Ա�ĸ�����,����������к�ͳһ����,���ٲ��컯�����Ķ���ɱ���

......

ѡ�ͽ���,���ǿ�ʼ

ѡ�ͽ���,�����´�����?��,���ڲ��ǿ�ʼ!��ʹѡ���˺��ʵ�ƽ̨��,��ʵ��Ӧ����Ҳ�����ȿӡ�

�����ܽ�����ҵ��ʹ�ÿ�Դ�������ʱ,ͨ���������Ŀ�:

��Ȩ������������;

��������;

�������йܴ��ڱ�;

ȱ������Ⱥͻ�������;

��Ϊ����ؼ���Ӧ���ṩ�ɿ�֧��;

......

���“�ܿ�”��?���ֱ�ӵķ������Dz�����ҵ���������������ڿ�Դ�������,��ҵ���������ʺϴ������ҵʹ��,��Ϊ���������ҵ�������в��Ժ���֤,�ܹ��ṩ�����б�֤�İ汾,ͬʱҲ��֧�ֺ�ά���ɵİ汾��ͬʱ,��ҵ�������������ij��̻����ṩ��Ӧ�ķ���Э��(SLA),��ҵ�Ĺؼ�������Ӧ��ϵͳ����ij��ʱ����ڻ��֧�֡�����Ҫ����,����ҵ�����������Ԥ�����,�������á�

��������,Kubernetes��DC/OS��Դ���������ʹ��ʱҲ������ijЩ����,��Ҫӵ�и��õ�ʹ������,�Ǿ�Ҫ������ҵ�������������D2iQ ǡ��ͬʱ�ṩKubernetes��DC/OS����ҵ���������——Ksphere��DC/OS��ҵ�档

D2iQԭ��ΪMesosphere,��һ��2013���������������ҵ����ƽ̨�ṩ�̡�2014��,D2iQ�����1050����Ԫ��A������֮��,�����˵¹��ֹ�˾,2015�귢����������֪��DC/OS,2017����ʽ�����й�,���������ֹ�˾——��������˹�ƶ��Ƽ�����˾,2018��,���D������1.25����Ԫ,2019 ��,����˾���ƴ� Mesosphere ��ΪD2iQ,����ͬ�귢�� KUDO �� Konvoy��

D2iQ(Day-2-IQ)��ʲô��˼��?Day 2��һ������ǰ���Ѿ�������� DevOps����,ָ����ʵ�ֳ�ʼ����Ͷ������������,Ӧ�ó����������ڵij�������,�Լ�������ʩ��Ӧ�õĽ�����غ���ά�Ρ�����һ��,��ҵ��������������ȫ��ά���ȵ��������,IQ ������˸����Ƚ������ܻ��Ľ��˼·������,����Ϊ��ҵ�ṩ�Զ�����ά����Ʒ���ܻ��ȵȡ�D2iQ���������˾����ֻ��֧��Mesos��Kubernetes����,���Ǹ��۽�����ΰ�����ҵʹ�ÿ�Դ����,���Ӻͺ�ʱ�Ĺ�����

Ksphere:���Kubernetes����ԭ���������

Ksphere= Kubernetes+Kommander(K8s����ʽ�༯Ⱥ����)+ȫջ��ԭ��������ά���+KUDO��ԭ������ֿ�

����ڵ�����װKubernetes,����Kubernetesƽ̨�Ͳ�����ԭ��Ӧ��Ҫ���ӵö�,�����Dz�����õ�Kubernetes��Ⱥ,����Ҫ������������Ϊ���䡣��Ksphere��������ṩ�˱������ҵ������,��Ҫ��������:

Konvoy:��רΪ����ʹ��Kubernetes����ҵ��Ƶ�,�����ڿ籾�ء��ƺͱ�Ե�����н�������Ӧ�ó����Զ���;

Kommander:Kubernetes����ʽ�༯Ⱥ��������Ҫ���ͬʱ����Konvoy������Kubernetes������ɵļ�Ⱥ��������,�ṩ�༯Ⱥ��һ�������,�߱����л���ȫ�Ժͼ�ع���,֧�ֻ����/����/��Ե��/���ز��������Kubernetes���а�;

KUDO:����KubernetesӦ�õ�����,����Ӧ�ó�������ݷ���Ҳ�ڲ������š���KUDO���Լ�Data Service Operator�Ĺ���,����Ч������״̬���ݷ���;

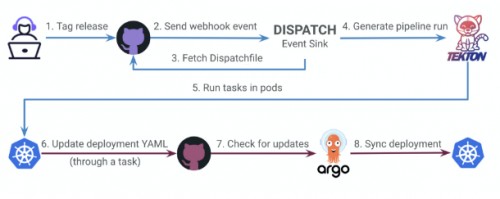

Dispatch:Kubernetesԭ����GitOps CI/CDƽ̨,�����ڿ��ٹ����Ͳ�����ԭ������Ӧ�ó���;

MKE����:����DC/OS,�ṩ��һ�Ŀ���ƽ��,�ɹ�����ͬһ����ϵͳ�����еĶ����Ⱥ���ܶȶ�Kubernetes��

ֵ��ע�����,Ksphere������GA��Ʒ��ͨ�����ģ��Ϲ������ز���,֤ʵ�˹ؼ���������,���������ҵ������ά�εIJ�ͬ����,Ҳ�в�ͬ�Ľ��������

DC/OS ��ҵ���������

DC/OS=Mesos+Marathon+��ԭ�����

DC/OS��רΪ���ģ����������Ƶ�,��������ҵ���ģ��Ⱥ����,�����ڶ���/����ƺͱ�Ե���������ʩ�����к������������ݷ���Ŀǰ���µİ汾��DC/OS 2.0.֧����ԭ��Ӧ�ó�����������ҵ������J2EEӦ�ó�������WindowsӦ�ó���D2iQ���ݿ�ѧ����(DSE)�ͷֲ�ʽ���ݷ���

����ҵʵ������������,DC/OS��ҵ��������������ṩ���ı�������:

�������:һ���ӿڿɿ����ơ��������ĺͱ�Ե���㻷��;

��������:�ṩ“������”�IJ���ʽ,�ɼ��ٰ�װ����չ����������Kubernetes��Spark��Kafka�ȸ��ӷ����ʱ�������;

��ǿ��������:�ṩ����������Բ��Ժ�֧��;

��֤�ֲ�ʽ�������ذ�ȫ:���ٶ�ȫ��в�ı�¶,����ִ��,��֤�Ϲ���;

���⻧:�����Ŷ�ʹ��ͳһ������ʩ,�����Դ������,���ƿ���Դ�������صķ��ʡ�

���м���,DC/OS��Ksphere��ʵ��֮·

“ֽ�ϵ����վ�dz,��֪����Ҫ���С�”

ѡ�ú�,��Ҫ�õú�,��β����ú�Ksphere��DC/OS��ҵ����?�����������й���ͨ����Ϸ��˾����ô����?

֧����ǧ�ڵ�,8������ʵ��,�й���ͨ��DC/OSʵ��֮·

���ź���ҵ����Ӫ֧��ϵͳ(cBSS)���й���ͨ����֧��ǰ̨���ۡ��ͻ������ڲ�֧��ȫ���̵�ҵ�����ϵͳ����2014�꿪ʼ,cBSS֧�ֵ��û�����һֱ�ڿ�������,2019���Ѿ��ﵽ��2.5�ڶ�,�û���������ʹϵͳ���ò������������졣

2015��,�й���ͨ��ʼ���cBSSϵͳ��ʼ��ȥIOE������������x86���������ع���,��ȡ����һЩ�ɹ�������֮��,cBSS ϵͳ�й�����ǧ̨x86�Ķ�����ϵͳ��Ⱥ,��Щ��Ⱥ�˴˶���,���������˹���ά�ķ�ʽ,����ڶ��������������ս,������Դ�����ʵ͡��˹�������ά��ʽ�׳���,����ϵͳ������һ�µ�����Ա�ظ�����,���ڴ����ظ������ȡ�

2016��,�й���ͨ��ʼ��cBSS������������,����ļ���ѡ������Mesos��MarathonΪ����ʵ��������Դ�ķֲ�ʽ������Э��,��Haproxy��Confd��EtcdΪ����ʵ�ַ���ע���ҵ�������,��DC/OSΪ����ʵ������������Դʵʱ�����������

���˽�,cBSSϵͳ�ܹ������7����55�ּƷ�Ӧ�õ�����������,�������̷�ֵ��8.5��,�վ�֧��100�����������ݴ�����

2017��,�й���ͨ��cBSSʵ���ڼ����ڲ��������ƹ�,����˶��⻧���������ȹ���ƽ̨——“�칬1.0”,��ƽ̨����DC/OS��Դ������϶��ƿ�����,��������:ʵ�ֿ����ЧЭ������ʱ���롢��ʱ�������������ɡ��Ҷȷ����淶������

2018��,�й���ͨ�����˹��ܸ�Ϊǿ��������汾——“�칬2.0”ƽ̨�����칬 1.0���,�ð汾ѡ������DC/OS��ҵ��������Kubernetes,������ƽ̨������,������Kubernetes��Ⱥ,ʵ����Kubernetes+DC/OS˫����ܹ���

2019��,�й���ͨ�Ƴ���“�칬 3.0”ƽ̨,��֧���ܲ�+21�����ӹ�˾+����ͻ���93��Ӧ��,��Դ����������60%,��άЧ������50%�����˽�,�칬 3.0�Ĺ�������ͳһ������Mesos������Ȼ���ʵ��,ƽ̨�ܹ�����D2iQ��Mesos��Marathon��DC/OS�ȿ�Դ����Ϊ����������������,֧��Intel��ARM CPU˫����ϵ�ܹ�,�ɶ������ϲ���ͬ�ܹ�������;���û춯˫��——Kubernetes��DC/OS�ܹ�,ʵ��Ӧ����Ǩ��,����������á�

Ŀǰ,�칬ƽ̨�ڱ�������������������������,������ǧ�ڵ�,����֧���˸���ȫ��32��ʡҵ���cBSSϵͳ,����Ҳ֧����Ӫҵ��AI�¿ͷ����꽱�������ߵ�ҵ��ϵͳ,��������Ӧ��ʵ�����ﵽ��8��

1�ڻ�Ա��500+��������ϵͳ,��Ϸ��˾��Ksphereʵ��֮·

Ϊ����Ӧ�г�����仯�ͼ�������,ij��Ϸ���ֹ�˾����ͨ��������ʵ��ȫ���������ĵ�����ͳһ,��Ϊ����ҵ��ϵͳԤ����չ������

����Ϸ��˾��Ksphereʵ���ܹ���Ϊ������:

��һ��:500+��������ϵͳ��CI/CD��������

��Ϸ��˾�ڵ�һ�ε�ϵͳ����,�漰�˳���500��������ϵͳ�Ĺ����뼯��,����֧�ֵ������ն��豸������30���,��Ա�˻�����1��,��Ȩ�����û�2.3��(������Ա3ǧ��,������Ա2����)������,ϵͳ���ݱ���Ҫ������ʵʱ�ɲ��ȫ�����ݱ���6����,��ʷ�����ɴ洢�豸����5��,���ؼ��������ñ��档

����֧�ֵ�������ϵͳ�����϶�,CI/CD�����ͳ�Ϊ��ϵͳ��ƿ�������,�ù�˾��Ҫ���½���һ��CI/CD����,��ϣ���������ܹ�������������:

����������ȫ����CNCF��Դ����,���⳧�̼�������;

������Ҫ��֤ Kubernetes ��ԭ��,�ܹ��������Kubernetes����Դ�������������,���Ⱥ����Դ������;

֧�ֶ��⻧����,�����ܹ���,�ܹ��������Ʒ�ŶӶ��ڳ�������/�����������Է�������;

֧�ֵ����¼����(SSO)�����RBAC���û�������֤����Ȩ��

������Щѡ������,��Ϸ��˾ѡ����D2iQ�ṩ��Dispatch�������,��ԭ�е�CI���̻�����,�Ż�����Kubernetes��ԭ�������µ�CI������CD���̡����˽�,�Ż�֮��,ԭ��2����һ�εIJ�Ʒ������������,�Ѿ����̵���2��,�Ҳ��Ի����Ѿ�ʵ����ÿ��һ�ζ�ʱ������

�Ż�֮���CI��CD����

�ڶ���:����ͳһ�ܿ�ƽ̨����

��һ�����֮��,����Ϸ��˾���˽�һ���Ż���Ŀ��,��Ҫʵ�ָ���ҵ����֮��ij����Ϣ����,���,������������ͳһ�ܿ�ƽ̨����ƽ̨����ҪĿ����ʵ����Ϣ��Դ������,�������Ӧ���ٶ�,ʵ����Ϣ����,ʵ�ִ����ݷ�������������������

����Ϸ��˾����Ӧ��ϵͳ�����ݿ��Ը��������Ϊ������:

�����ݾۺ���:����ҵ������־,�������ݾۺϵ�;

ʵʱ����������:���ṩ�ϸߵĶ�д����,������һ����Ҫ��;

ҵ�����������:��Ҫ����洢�˻�,Ȩ��,���Ƶ���Ϣ��

�������������,D2iQ��KUDO��״̬���ݷ����ܼ��俪Դ���ݷ����ṩ����Ӧ��֧��:

��Դ����ݾۺ�������,KUDO�ṩ�˲�ͬ�����ݴ�������,������ڸ�ҹBatch����,KUDO��Ŀ�ṩCassandra��Spark����ͻ�ҵ������־�ķ������ۺ���洢;����ʵʱ������������,KUDO��Ŀ�ṩKafka��Kafka Connect��Spark Streaming��֧�ſͻ��������ݵľۺϴ���;

���ʵʱ����������,����KUDO��ܵ�MySQL�������߿��ý�������ṩ��������������ѡ��˼·;

���ҵ�����������,KUDO�ṩ�˸߿��õ�HDFS��Ⱥ,����ͻ��ķֲ�ʽ�洢����

��ľ�ѳ���,��̬����ز�����

����451 Research��Ԥ��,����2022��,Ӧ�������������г���ģԤ�ƽ��ﵽ43����Ԫ,��2019�����������һ���ݲ�����ʾ�����г���ǰ������,ͬʱҲ˵������һ�����кܶ�հס���Ҫ�ƶ�������������ǰ��չ,����һ�ҹ�˾�Dz����е�,���������������̬��������

��ľ�ѳ���,��̬���軹��Ҫÿ����˾�����Ŭ������D2iQΪ��,����Core Kubernetes���ڵ���������֮һ,Ŀǰ��Kubernetes��Ŀ�Ĵ����ύ������ȫ����ҵ������ǰʮ����������,���������������洢�ӿڱ�(CSI),ͬʱ��֧�ֶ����Դ��Ŀ,����Helm��Ŀ��Kubernetes��Kubebuilder��SIG API Machinery��Controller Runtime��Cluster API��

ͬʱ,D2iQ�����Ľ������Ҳ����������̬ϵͳ�е���������������,�û���������ѡ��ؼ��ļ����������

���˽�,Ŀǰ�Ѿ����ϵļ�������������洢ƽ̨Portworx��Hedvig��OpenEBS ��Pure Service Orchestrator ,����ƽ̨Argo Tunnel��Calico��Traefik,��ȫƽ̨NG-WAF��Aqua��Open Policy Agent,���ݿ�Couchbase��MongoDB��Cassandra��InfluxDB��ArangoDB,Ӧ����Lightbend��Gitlab,������/��ϢKafka��Flink�������� | ���棩

|

|